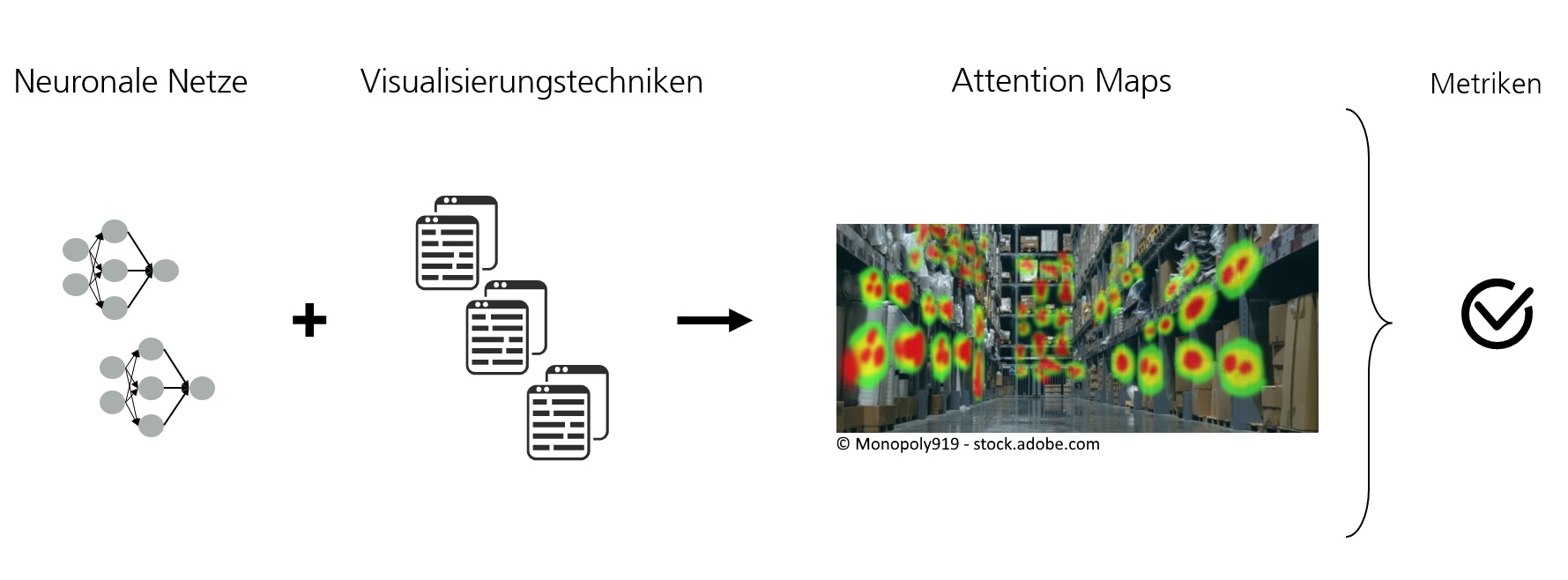

Visualisierung der Entscheidungsfindung Neuronaler Netze

Ausgangssituation

IDS hat eine Trainingsplattform entwickelt, die es Expert*innen ermöglicht, durch Hochladen eigener Bilddaten Neuronale Netze zu trainieren. Trotz hoher Genauigkeiten der eingesetzten Neuronalen Netze gestaltet sich eine Diagnose im Fehlerfall oftmals schwierig und hemmt so die Verbreitung der Algorithmen. Eine von IDS entwickelte intuitive Visualisierung in Form sogenannter Attention Maps (Heat Maps) soll es ermöglichen, kritische Entscheidungen leichter nachzuvollziehen, um damit die Akzeptanz Neuronaler Netze im industriellen Umfeld zu erhöhen. Um die Leistung des Heat Map-Verfahrens bewerten zu können, fehlt ein verlässliches Standardverfahren, welches die Ansprüche einer industriellen Umgebung repräsentiert.

Lösungsidee

Ziel ist es, zu überprüfen, ob der Einsatz von Attention Maps die Erkennung von Adversarial Attacks sowie verzerrten (engl. biased) Vorhersagen des Neuronalen Netzes erlaubt. Zu diesem Zweck werden verschiedene Methoden zur Erzeugung von Attention Maps anhand zuvor definierter Metriken miteinander verglichen. Um die Prüfung durchführen zu können, müssen zudem Techniken zur Erzeugung von Adversarial Attacks und zur Erstellung Neuronaler Netze mit künstlichen Fehlern (Bias) eingesetzt werden. Vielversprechende Techniken und Metriken können zu einem Testprozess zusammengeführt werden, welcher die Güte von Heat Map-Verfahren nachvollziehbar quantifiziert.

Projektnutzen

- Durch die von IDS bereitgestellte Trainingsplattform können Expert*innen Wissen über die Bildinhalte in einen Algorithmus einfließen lassen, um diesen stetig anzupassen und zu verbessern

- Eine intuitiv zu verstehende Visualisierung der Aufmerksamkeit des Neuronalen Netzes ermöglicht es Nutzer*innen, Fehler nachzuvollziehen und Schwachstellen im Datensatz zu finden

- Die evaluierten Heatmap-Techniken visualisieren die Bildbereiche, welche für die Entscheidung durch das Neuronale Netz besonders relevant sind. Diese Visualisierungen ermöglichen es Ungeschulten, zu erkennen, wie die trainierten Netze funktionieren. Langfristig wird dies zu einer erhöhten Akzeptanz Neuronaler Netze im industriellen Umfeld führen.

Umsetzung der KI-Applikation

Die Umsetzung wurde mit dem öffentlich zugänglichen ImageNet-Datensatz durchgeführt. Um Bias und Adversarial Attacks zu erkennen, wurde ein verzerrtes Netz trainiert und mit Rauschmustern überlagerte Bilder generiert. Des Weiteren wurden Bewertungsmetriken zur Messung der Qualität der erzeugten Attention Maps entwickelt. Zur Evaluation der beiden Use Cases wurden drei Methoden zur Erzeugung von Attention Maps auf verschiedene Netzarchitekturen angewandt und die erzeugten Heat Maps mithilfe der Metriken bewertet. Die Ergebnisse zeigen, dass Attention Maps verzerrte Vorhersagen kenntlich machen und Hinweise auf Adversarial Attacks liefern können. Die erarbeiteten Methoden helfen IDS dabei, eigens entwickelte Heat Map-Verfahren zu evaluieren und zu optimieren.

Ein gemeinsames Ziel des Fraunhofer IPA und uns ist es, KI anwendbar und erklärbar zu machen. Das IPA hat uns während des Quick Checks durch Kompetenz und Tatkraft diesem Ziel näher gebracht. Es konnte bereits in der kurzen Projektzeit gezeigt werden, dass nicht nur die Entscheidung Neuronaler Netze wichtig ist, sondern auch welche Bildmerkmale dazu führen, um Datenmanipulation und -verzerrungen zu erkennen. Wir hoffen, die produktive Zusammenarbeit weiter fortsetzen zu können.

bestätigen Alexander Balz und Alexander Windberger, Testimonials der IDS Imaging Development Systems GmbH.

Gefördert durch